2조ㅤㅤ

프로젝트 개요

기술개발 과제

국문 : 컴퓨터 비전을 활용한 노면 손상의 진행도 측정 자동화 프로젝트

영문 : Automation Project for Measuring the Progression of Road Surface Damage Using Computer Vision

과제 팀명

2조

지도교수

조수진 교수님

개발기간

2024년 9월 ~ 2024년 12월 (총 4개월)

구성원 소개

서울시립대학교 토목공학과 20188600** 권*현 (팀장)

서울시립대학교 토목공학과 20198600** 김*준

서울시립대학교 토목공학과 20198600** 박*혁

서울시립대학교 토목공학과 20198600** 박*현

서울시립대학교 토목공학과 20198600** 이*헌

서론

개발 과제의 개요

개발 과제 요약

딥러닝과 컴퓨터 비전 기술을 활용하여 노면의 손상을 자동으로 탐지하고, 손상의 정도(상대적인 깊이 및 크기)를 측정하는 시스템을 개발한다. 이를 통해 인력 부족으로 인한 노면 관리의 비효율성을 개선하고, 선제적인 보수 작업을 가능하게 하여 도로 안전성을 향상하는 것을 목표로 한다.

개발 과제의 배경

최근 도로 관리 분야에서는 인력 부족으로 인해 노면 손상의 선제적 탐지와 보수가 미흡해지고 있다. 이는 싱크홀과 같은 대형 사고에 대한 대처가 늦어지는 원인이 되기도 한다. 전통적인 노면 손상 탐지 방법은 인력 의존도가 높아 시간이 많이 소요되고, 정확도가 낮으며, 지속적인 모니터링이 어렵다. 이를 해결하기 위해 한국도로공사에서는 딥러닝 기반의 손상 탐지 모델을 도입하였으나, 낮은 일반성으로 인해 기존 문제를 완전히 해결하지는 못하고 있는 실정이다.

개발 과제의 목표 및 내용

1. SegFormer 모델을 활용한 노면 손상 탐지 시스템 개발

Transformer 기반의 SegFormer 모델을 통해 노면 손상을 정확하게 탐지하고 분류한다. 기존 CNN 기반 시스템보다 높은 성능 지표(정확도, 정밀도, 재현율 등)를 보이는 것을 목표로한다.

2. 포트홀의 상대적 깊이 측정을 위한 Depth-Anything-V2 모델 구현

포트홀의 깊이 정보를 추정하여 손상의 심각도를 평가한다. 깊이 정보와 손상 영역의 크기를 종합하여 보수 우선순위를 선정한다.

3. 노면 손상 탐지 및 측정 자동화 프로그램 개발

도로 촬영부터 손상 분류, 포트홀 이미지 추출, 깊이 추정, 손상 정도 알림까지의 전체 과정을 자동화한다.

관련 기술의 현황

관련 기술의 현황 및 분석(State of art)

- 서울시 노면 손상 탐지 시스템

서울시에서는 AI기반의 도로 위험 요소 탐지 시스템인 RiaaS를 도입하여 운영하고 있다. 이 시스템은 서울 시내 대중교통에 설치하여 도로의 각종 위험 요소를 실시간으로 탐지하는 데 활용되고 있다. 장치를 부착한 차량이 주행 중 위험 요소를 발견하면 별도의 조작 없이 사진과 위치 정보를 실시간으로 관련 부서에 전송하는 방식으로 운영된다. 그러나 이 시스템은 포트홀 발생 지점을 단순히 블록화하여 대략적인 면적을 계산하는 수준에 그치고 있으며, 정확한 균열의 크기 및 깊이 측정까지는 이루어지지 않아 손상의 심각도 평가에 한계가 있다.

- 한국도로공사의 포트홀 탐지 시스템

최근 국정감사에서 한국도로공사의 CNN 기반 포트홀 자동탐지 시스템이 배수구나 보수 완료 포트홀, 차선 도색 벗겨짐, 타이어 자국 등을 포트홀로 오인하는 사례가 지적되었다. 균열, 포트홀 같은 노면 손상 요소들은 넓은 도로 배경 위에 분포해 있으며, 이러한 요소들은 크기와 위치가 불규칙적이다. CNN은 주로 국소적인 특징을 추출하는 데 중점을 두기 때문에 전역적인 맥락에 대한 이해가 부족하여 도로의 배경 요소와 노면 손상의 경계, 종류를 정확하게 분류하기 어려울 수 있다.

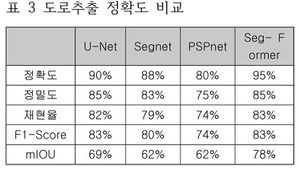

- CNN 모델과 Segformer 모델 비교

노면 손상 요소들은 크기와 위치가 불규칙적으로 넓은 도로 배경 위에 분포한다. 기존의 CNN 기반 모델은 이러한 특성을 효과적으로 반영하지 못하여 정확한 손상 탐지에 어려움이 있다. 반면, Transformer 기반의 SegFormer 모델은 Self-Attention 메커니즘을 통해 이미지 내 모든 픽셀 간의 관계를 학습한다. 때문에, 복잡한 배경과 손상 요소 간의 상호작용을 효과적으로 이해하고 다양한 손상 요소들을 정확하게 식별할 수 있다.

이재관 등(2024)의 연구에서는 SegFormer 모델이 CNN 기반 모델(U-Net, SegNet, PSPNet)보다 도로 네트워크 추출에 있어 정확도, 정밀도, 재현율, F1-Score, mIoU 등 모든 지표에서 우수한 성능을 보임을 확인하였다. 따라서 본 과제에서는 SegFormer 모델을 활용하여 노면 손상 탐지의 정확도를 향상시키고자 한다.

시장상황에 대한 분석

◇ 국민권익위원회의 보고서에 따르면 22년 1월부터 24년 2월까지 민원분석시스템(국민신문고, 안전신문고, 지자체 민원 창구)에 수집된 포트홀 관련 민원은 총 52,262건이다. 전체 민원의 90.2%(47,166건)은 포트홀 관련 도로이용 불편신고로, 대다수는 위치를 특정해 보수를 요청하는 단순신고 형태를 보였다. 9.8%(5,098건)은 포트홀 사고로 인한 차량파손 배상요청 내용이다.

◇ 지난해 국정감사에서 한국도로공사가 제출한 자료에 따르면 포트홀로 인한 피해배상 건수와 금액이 매년 증가하고 있는 것으로 나타났다. 2018년부터 2023년 6월까지 고속도로 포트홀로 인한 피해배상 건수는 총 5,696건이고 배상액은 약 91억 원으로, 2018년에 비해 2022년 배상 건수는 약 2배, 배상 금액은 약 6배 증가하였다.

개발과제의 기대효과

기술적 기대효과

◇ 실시간 노면 손상 탐지에 따른 신속한 도로 보수공사 유도

◇ 정량적인 노면 손상 정보 수집을 통해 효율적인 보수계획 수립을 지원하여, 도로 관리 분야 인력 부족 문제 해결

경제적, 사회적 기대 및 파급효과

◇ 기존의 도로포장 관리 체계를 자동화하여 인력 부족 문제를 해결하고 시간과 비용 절감

◇ 선제적인 도로 보수를 통해 노면 파손 관련 사고 건수 감소

◇ 노면 파손에 따른 피해보상액을 절감하여 도로 관리 주체의 경제적 부담 완화

◇ 도로 보수 관련 민원 감소를 통해 담당 공무원의 업무 부담 경감

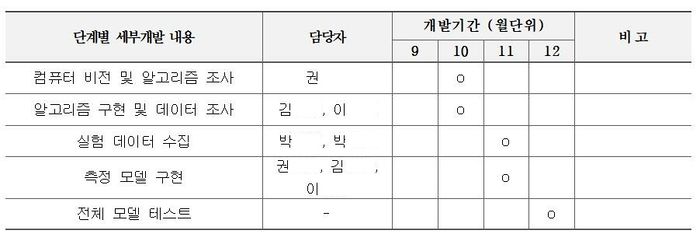

기술개발 일정 및 추진체계

구성원 및 추진체계

설계

개념설계안

SegFormer 모델 설명

SegFormer는 기존 CNN을 사용하는 세그멘테이션 모델과 달리, 전역적으로 모든 픽셀 간의 관계를 계산하는 Transformer를 기반으로 한 세그멘테이션 모델이다. 이 모델은 기존 Vision Transformer(ViT)에서 사용하던 positional embedding(이미지 패치의 위치 정보를 제공하는 요소)을 사용하지 않으며, 계층적 구조를 통해 연산 속도를 높이는 것이 특징이다.

SegFormer는 계층적인 구조를 구현하기 위해 overlap patch merging 방식을 사용한다. 이는 이미지의 특징 맵을 겹치게 나눈 후, 패치들을 합치고 공간적 차원을 줄여 새로운 특징 맵을 생성하는 방법이다.

기존 Self-Attention 메커니즘은 해상도가 커질수록 연산 복잡도가 증가하는 단점이 있다. 이를 해결하기 위해 SegFormer는 Efficient Self-Attention 방식을 도입하여, 해상도를 줄이는 비율 R을 적용한다. 이를 통해 입력 패치의 차원 N*C를 N/R*C로 변환하여 연산 효율을 높인다.

Mix-FFN은 positional embedding을 대체하기 위해 기존 Feedforward Network(FFN)에 CNN 연산을 결합한 형태로 사용한다. 이 방식은 특징 맵을 고차원 공간으로 투영한 후 활성화 함수를 적용하고, 투영된 특징 맵을 합성곱 레이어에 전달하며, 변환된 특징 맵을 활성화 함수로 다시 투영하여 새로운 공간으로 변환한다.

결과적으로, 각 Transformer 블록은 이러한 과정을 통해 다른 차원의 특징 맵을 생성하며, 생성된 특징 맵은 최종적으로 MLP Layer로 전달된다.

SegFormer의 디코더는 MLP 레이어만으로 구성된다. 디코더는 인코더에서 출력된 다중 계층 특징(Multi-Level Features)을 C 차원으로 투영하는 데 사용된다. 이후 모든 출력을 H/4*W/4 차원으로 업샘플링(up-sampling)한다. 업샘플링된 각 출력 값은 4C 차원의 모든 계층적 표현을 C 차원으로 융합한다. 마지막으로, 데이터를 클래스 개수만큼 투영하여 세그멘테이션 마스크를 예측한다.

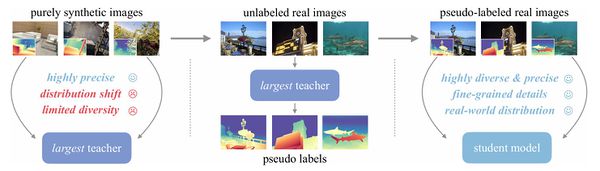

Depth-Anything-V2 모델 설명

기존 단안 깊이 추정(Monocular Depth Estimation, MDE) 모델들은 세부 묘사와 강건성 중 하나에만 초점을 맞추거나, 데이터 노이즈 및 모델 효율성의 한계에 직면해 왔다. Depth Anything V2는 모델 구조와 학습 전략에서 기존 방법론을 개선하여 세부 묘사와 강건성을 동시에 개선하였다.

Depth Anything V2의 구조는 크게 교사 모델(Teacher Model)과 학생 모델(Student Model)로 나뉜다. 교사 모델은 Vision Transformer(ViT) 기반의 DINOv2를 채택하였다. 기존 Depth Anything V1에서 사용된 실제 이미지 레이블 데이터의 노이즈 문제(투명 물체나 반사 표면의 잘못된 깊이 값)를 해결하기 위해 Depth Anything V2에서는 이를 Hypersim, Virtual KITTI 2 같은 정확한 합성 이미지 데이터셋으로 대체하여 교사 모델을 학습하였다. 그리고 교사 모델이 Google Landmarks, LSUN, Open Images 등 대규모 비라벨 실제 이미지에 대해 가짜 라벨을 생성하는 방법을 통해 합성 데이터와 실제 데이터 간의 분포 차이를 줄여 모델의 일반화 성능 향상을 도모하였다. 이렇게 교사 모델의 정밀한 예측을 통해 생성한 가짜 라벨 데이터로 학생 모델을 학습시켜, 학생 모델이 교사 모델의 예측을 모방하도록 하였다.

Depth Anything V2는 의자 다리 같은 얇은 물체나 작은 구멍까지 정확하게 깊이를 예측할 수 있으며 유리, 거울과 같은 투명하거나 반사되는 표면에서 높은 성능을 보인다. 또한 복잡한 레이아웃, 다양한 조명 조건, 동적 객체 등이 포함된 복잡한 장면에서도 강건성(Robustness)을 보여준다. 그리고 실내외 등 다양한 환경에서 높은 일반화 성능을 보이며 Zero-shot 설정에서도 기존 모델을 능가한다.

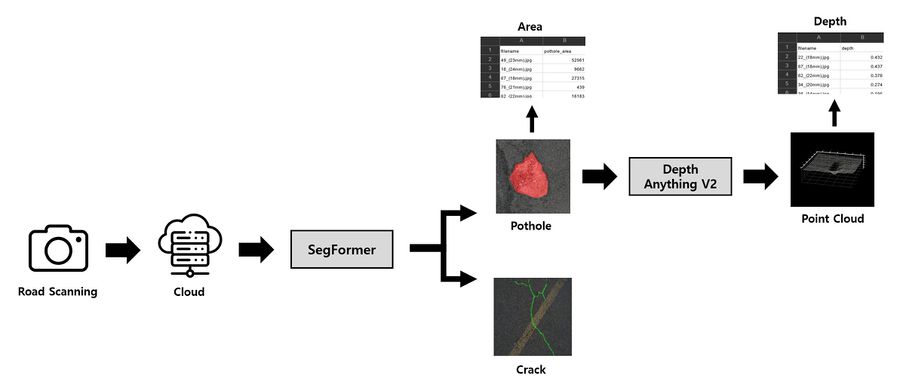

전체 시스템 개요

(1) 노면 영상 촬영

(2) 노면 영상을 클라우드에 업로드, 이미지 추출

(3) SegFormer 모델을 통해 노면 손상(포트홀, 크랙) 탐지 및 분류

(4) 포트홀 픽셀 단위 면적 계산

(5) 탐지된 포트홀 이미지를 Depth Anything V2 모델에 입력

(6) 포인트 클라우드 생성 및 포트홀 깊이 추정

상세설계 내용

SegFormer 모델 구현

- 모델 학습에 사용한 데이터 종류

- 데이터 증강 기법의 필요성

실제 도로 환경은 조명 조건, 날씨, 카메라 각도, 노면 재질 등 다양한 요인에 의해 이미지의 특성이 달라진다. 노면 손상 탐지 모델의 일반화 능력을 향상하기 위해서는 다양한 환경에서의 데이터를 학습하는 것이 중요하다. 주어진 데이터는 제한적이므로 다양한 데이터 증강 기법을 활용한다. 데이터 증강은 도로 환경의 변화를 모사하여 모델의 실용성을 높이고 다양한 상황을 인공적으로 만들어 모델이 예측하지 못한 상황에서도 안정적인 성능을 발휘하도록 도와준다. 또한, 데이터 다양성을 높여 모델이 학습 데이터에 과적합되는 것을 방지할 수 있다.

- 적용한 데이터 증강 기법

-랜덤 수평 및 수직 뒤집기

-랜덤 회전 및 스케일링

-랜덤 이동: 노면 손상 구역의 위치, 손상의 크기, 공간적 변형에 대한 다양한 케이스를 학습할 수 있도록 한다.

-밝기, 대비, 채도 조절: 다양한 조명 조건과 변화에 대한 적응력을 높인다.

- 가중치

노면 손상 탐지 데이터셋에서 배경 클래스(정상 도로)는 이미지의 대부분을 차지하고, 손상 클래스(크랙, 포트홀 등)는 상대적으로 매우 적은 픽셀 수를 가진다. 그로 인해, 학습 과정에서 모델이 배경 클래스에 편향되어 손상 클래스를 제대로 학습하지 못하는 문제가 일어날 수 있다. 이러한 클래스 불균형 문제를 완화하기 위해 손실 함수에서 각 클래스에 대한 가중치를 적용하여 손상 클래스의 중요도를 높여 모델이 손상 클래스에 더 집중하여 학습할 수 있도록 해야한다.

클래스별 픽셀 수 집계를 하여 비율을 계산하여 다음과 같은 가중치를 설정하였다.

클래스 0 (배경): 가중치 0.0041

클래스 1 (크랙): 가중치 0.5255

클래스 2 (포트홀): 가중치 0.4704

- 손실 함수

Focal Loss는 Lin et al.(2017)이 제안한 손실 함수로, 클래스 불균형 문제를 해결하기 위해 개발되었다. 또한, 가중치 조정 항목을 추가하여 어려운 예제(hard example)에 더 많은 가중치를 부여하고, 쉬운 예제(easy example)에 대한 영향력을 감소시킬 수 있다.

객체 탐지(Object Detection)나 세그멘테이션(Segmentation) 작업에서 배경 클래스가 대부분을 차지하며 관심 객체는 적은 경우가 많은데. 이때 일반적인 교차 엔트로피 손실(Cross-Entropy Loss)로는 희귀한 클래스에 대한 학습이 제대로 이루어지지 않을 수 있다. 본 과제에 사용한 노면 데이터의 경우 배경(클래스, 0)이 전체 데이터에서 97%이상으로 크랙(클래스, 1)과 포트홀(클래스, 2)에 비해 매우 편중되어 있기에 사용하였다.

Dice Loss’는 이미지 분할 작업에서 많이 사용되는 손실 함수로, 분할된 결과와 실제 마스크 간의 겹침 정도를 측정한다. 주로 의료 영상 분할 분야에서 사용되었으나, 최근에는 일반적인 세그멘테이션 작업에서도 활용되고 있다. Dice 계수(Dice Coefficient)는 두 집합 사이의 유사도를 측정하는 지표로, 값은 0에서 1 사이를 가진다.

Dice Loss는 Dice 계수를 손실 함수로 변환한 것으로, 다음과 같이 정의된다.

Dice Loss는 예측 마스크와 실제 마스크를 비교하여 겹치는 부분을 최대화하기 때문에 경계 영역에서의 성능을 개선할 수 있다. 크랙이나 포트홀의 경계 부분을 정확하게 분할하는 것이 중요하다고 판단했기 때문에 사용하였다. 또한 픽셀 수에 의존하지 않고 분할 영역의 겹침을 계산하므로 Focal Loss와 마찬가지로 클래스 불균형의 영향을 줄일 수 있다.

Focal Loss와 Dice Loss의 결합한 최종 손실 함수는 다음과 같이 정의된다.

Focal Loss는 클래스 불균형 문제를 완화하지만 분할된 객체의 형태나 경계 부분에 대한 정보는 충분히 제공하지 않는다. Dice Loss는 분할 영역의 겹침을 최대화할 수 있으므로 두 손실 함수를 결합하여 각각의 단점을 보완하고, 모델의 분할 성능을 최적화할 수 있을 것으로 기대하였다.

- 구현 모델의 성능 지표

Mean IoU (평균 교차분율): 0.7419

Mean IoU는 모델의 세그멘테이션 정확도를 측정하는 주요 지표이다. 이는 예측된 세그먼트와 실제 세그먼트 간의 교집합을 합집합으로 나눈 값을 각 클래스마다 계산한 후 그 평균을 구한 것이다. 값이 1에 가까울수록 모델의 예측이 실제와 매우 유사하다는 것을 의미하며, 0.7419라는 값은 모델이 상당히 높은 수준의 정확도를 가지고 있음을 나타낸다.

Accuracy (정확도): 0.9847

정확도는 전체 픽셀 중에서 모델이 올바르게 분류한 픽셀의 비율을 나타낸다. 0.9847은 모델이 매우 높은 정확도를 의미하지만, 평균적으로 배경 클래스가 97% 이상인 데이터를 사용하였기 때문에 모델이 전체 이미지를 배경을 예측하여도 정확도는 97%에 준하는 값이 나오게 된다. 때문에, 현 과제에서는 Mean IoU 값이 모델의 성능을 파악하는 데에 더 중요한 지표이다.

Precision (정밀도): 0.8275

정밀도는 모델이 양성으로 예측한 픽셀 중 실제로 양성인 픽셀의 비율이다. 높은 정밀도는 모델이 잘못된 양성 예측을 적게 한다는 것을 의미한다.

Recall (재현율): 0.8331

재현율은 실제 양성 픽셀 중에서 모델이 올바르게 예측한 픽셀의 비율이다. 높은 재현율은 모델이 실제 양성 사례를 놓치지 않고 잘 찾아낸다는 것을 의미한다.

F1 Score: 0.8296

F1 스코어는 정밀도와 재현율의 조화평균으로, 두 지표의 균형을 평가하는 지표이다. 값이 높을수록 모델이 정밀도와 재현율 모두에서 우수한 성능을 보인다는 것을 의미한다. 0.8296은 모델이 전반적으로 균형 잡힌 성능을 가지고 있음을 나타낸다.

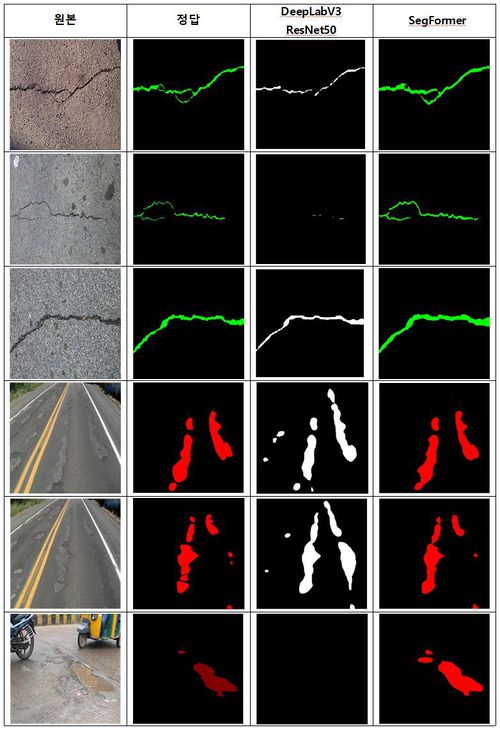

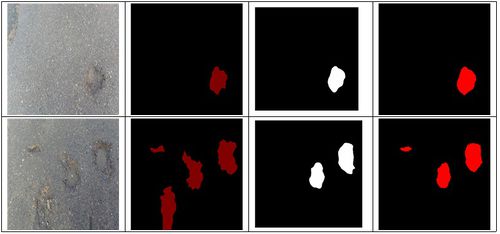

CNN 모델과 SegFormer 모델의 노면 손상 탐지 성능 비교

- 노면 손상 탐지 결과

- 결과 분석

정확도(Accuracy)

CNN 모델은 정확도가 99%로 매우 높고, SegFormer 모델의 정확도는 98.47%로 근소하게 낮다. 그러나 크랙, 포트홀 등의 노면 손상 요소는 배경에 비해 차지하는 비율이 낮기 때문에, 모델이 배경을 대부분 정확히 예측하더라도 전체 정확도는 매우 높게 나올 수 있다. 이처럼 클래스 간 불균형이 있는 경우에는 IoU 같은 지표가 더 중요할 수 있다.

IoU(Intersection over Union)

CNN 모델은 IoU가 44%로 비교적 낮다. 이는 모델이 예측한 손상 영역이 실제 손상 영역과 겹치는 비율이 낮다는 의미이다. 즉, CNN 모델은 노면 손상을 정확히 구분하는 데 있어 한계가 있음을 나타낸다. 반면 SegFormer 모델은 mIoU가 74.19%로, 손상 영역을 더 정확하게 예측하고 구분하는 성능을 보인다. 이는 SegFormer 모델이 복잡한 도로 손상 영역을 잘 포착하고 있다는 것을 의미한다.

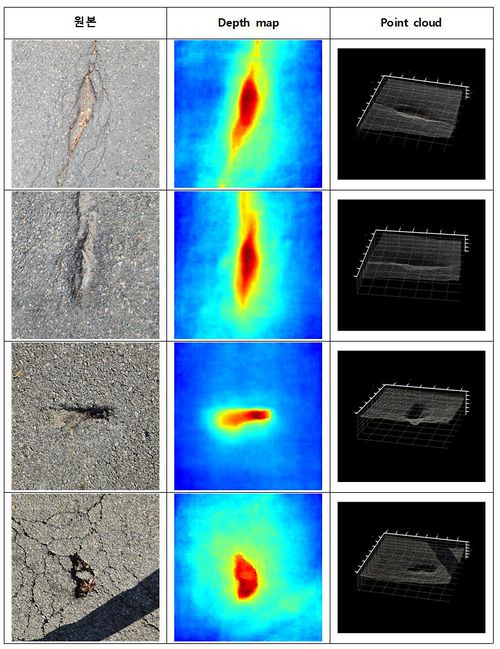

Depth-Anything-V2 모델 구현

- 포트홀 이미지에 대한 모델의 깊이 추정 결과

기학습된 Depth Anything V2 모델을 통해 포트홀 이미지의 깊이를 추정하고 이를 깊이 맵과 포인트 클라우드로 나타내었다. 그 결과, 도로 전체 평면이 기울어지도록 깊이 추정을 하였고 이에 따라 포트홀의 깊이 값에도 왜곡이 발생하였다. 포트홀의 정확한 깊이를 분석하려면 포인트 클라우드로 나타낸 도로 평면이 XY 평면과 평행해야 한다.

- 주성분 분석(PCA)을 통한 포인트 클라우드 보정

깊이 값의 왜곡을 보정하기 위해 주성분 분석(PCA)을 이용한다. PCA는 데이터의 분산 방향을 분석하여 주요 패턴을 파악하는 기법이다. 포인트 클라우드 데이터의 경우, PCA를 통해 주요 평면(도로면)에 수직인 법선 벡터를 찾을 수 있다. 이는 포인트 클라우드의 주요 평면에서 가장 작은 분산 방향이 법선 벡터와 일치한다는 사실에 기반한다. PCA를 통해 주성분을 계산하고 가장 작은 분산 방향(세 번째 주성분)을 법선 벡터로 선택한다.

이렇게 찾은 법선 벡터가 Z축 방향과 일치하도록(즉, XY 평면과 수직이 되도록), 법선 벡터와 Z축의 외적을 이용해 회전축을 찾고 회전 각도를 계산한 뒤 회전 행렬을 생성한다. 마지막으로 회전 행렬을 포인트 클라우드 좌표에 적용하여 포인트 클라우드를 XY 평면과 평행하게 정렬한다.

보정결과

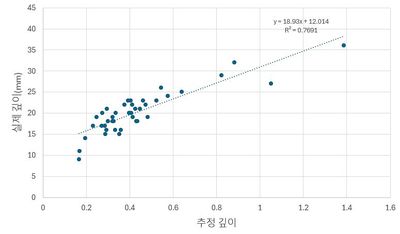

- 깊이 추정 모델의 일반화 성능

Depth Anything V2 모델의 일반화 성능을 평가하기 위해 포트홀 이미지를 직접 촬영하고 실제 깊이도 측정하여 이를 모델의 추정값과 비교하였다. 깊이 추정값을 독립변수, 실제 깊이를 종속변수로 놓고 회귀분석을 진행한 결과, 상관계수 0.877, 결정계수 0.769, 표준오차 2.485을 얻었다.

- 한계점

이 모델은 일반적인 실내외 이미지를 통해 학습이 이루어졌다. 일반적인 실내외 장면에는 포트홀과 같은 패턴이 흔하지 않기 때문에 모델은 이러한 패턴을 제대로 해석하지 못할 수 있다. 따라서 모델이 포트홀을 평면의 일부로 간주하거나, 깊이를 과소 또는 과대 추정할 가능성이 있다. 이러한 문제를 해결하기 위해서는 포트홀 깊이에 초점을 맞춘 데이터셋을 이용해 모델을 재학습할 필요가 있다. 조명, 도로 표면, 포트홀 크기, 카메라 위치·각도 등 다양한 환경 조건에서 촬영한 포트홀 이미지 및 깊이 데이터셋을 구축하고, 모델을 재학습하면 단안 깊이 추정 모델의 성능을 개선할 수 있을 것으로 기대한다.

결과 및 평가

완료 작품의 소개

테스트 데이터 수집

테스트베드는 서울 노원구 중계동 백사마을 일대를 선정하였다.

차량에 카메라를 설치하는 상황을 가정하여 자전거에 카메라를 거치하고 노면 영상을 촬영하였다. 촬영 기종은 Galaxy S22+ 모델이며, 기본 카메라를 사용하였다.

촬영한 영상 길이는 총 20분이며 1,200여 장의 이미지를 추출하였다.

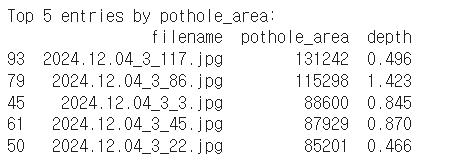

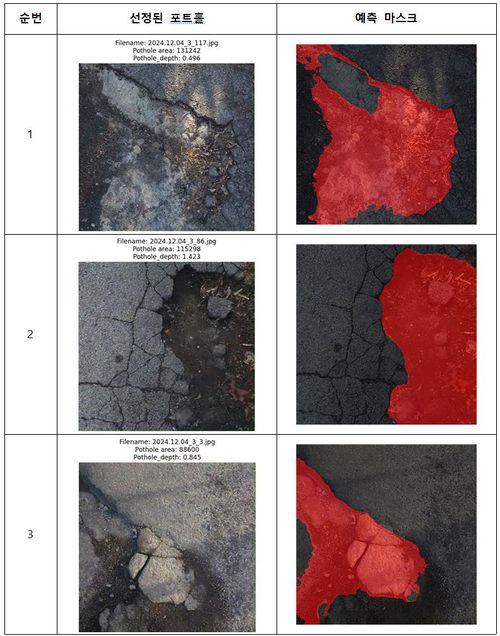

보수 우선순위 선정 결과

- 면적순

- 깊이순

포스터

참고문헌

1. “12억 썼는데…도로 파임 AI 탐지시스템 오작동률85%” 연합뉴스TV. 2024. 10. 27. https://www.youtube.com/watch?v=YLLhTQVOEHw

2. 이재관 외, 딥러닝 기반 도로 네트워크 추출 방법론 비교, 2024.

3. 국민권익위원회, 국민이 안심하는 생활안전 확보를 위한 「포트홀(도로파임)」관련 민원 분석, 2024.

4. “[2023 국감] 고속도로 포트홀 5년간 2만1115건, 배상금액만 91억 원 달해” 국제뉴스. 2023.10.12. https://www.gukjenews.com/news/articleView.html?idxno=2829006#rs

5. 한국도로공사, 도로 노면 손상 탐지를 위한 영상 처리 및 딥러닝 이미지 분류 장치 및 방법, 2019.

6. Enze Xie et al, SegFormer: Simple and Efficient Design for Semantic Segmentation with Transformers, 2021.

7. Lihe et al, Depth Anything V2, 2024.

8. Lin et al, Focal Loss for Dense Object Detection, 2017.